Introduction

Les débats actuels sur la prédation scientifique tendent à enfermer une grande diversité de situations dans une catégorie moralement saturée, où l’étiquette vaut souvent condamnation (Mills & Inouye, 2021). Ce réductionnisme est particulièrement problématique pour de nombreuses revues éditées dans les Suds, qui peuvent produire des signaux de faible professionnalisation (procédures, transparence, normalisation, archivage, etc.) sans pour autant relever d’une intention frauduleuse. Partir de cette distinction permet de déplacer l’analyse de la chasse aux « mauvais acteurs » vers l’étude des conditions matérielles, cognitives et institutionnelles qui fabriquent — ou entravent — la crédibilité éditoriale (Azilan, 2025).

Un symptôme, à la fois banal et éclairant, concentre ces tensions : l’affichage sur les sites de revues éditées en Afrique d’une mosaïque d’« index », de badges et de logos hétérogènes, parfois prestigieux, parfois obscurs, parfois simplement administratifs, présentés comme gages de reconnaissance internationale. On y voit ResearchGate, Index Copernicus, Academia, HAL ou encore le DOAJ. Ce que ces sites donnent à voir est une grammaire de la reconnaissance sous contrainte, où des indicateurs techniques sont réinterprétés comme des marques de valeur scientifique. Ce glissement révèle un champ éditorial profondément inégalitaire, où la légitimité d’un travail de recherche tient moins à sa qualité intrinsèque qu’à sa capacité à circuler dans les bons dispositifs et à apparaître dans les bons répertoires. Ce qui se joue ici est plus fondamental qu’un défaut de mise en forme. Dans un contexte marqué par la course à l’internationalisation et à la conformité aux standards dominants, l’accès à la visibilité scientifique reste structurellement inégal, et les revues du Sud sont particulièrement concernées par ces asymétries infrastructurelles.

L’hypothèse directrice est que nombre de revues africaines francophones se trouvent prises dans une confusion structurante entre trois registres a priori distincts : d’abord, l’indexation comme opération technique d’intégration à une base ; ensuite, le référencement comme présence repérable dans des moteurs ou catalogues qui trient les revues selon des règles de pertinence établies ; enfin, le signalement comme simple inscription dans un répertoire, sans audit de la revue, ni de ses contenus. Cette confusion n’est pas seulement un déficit d’information. Elle traduit une tension entre l’aspiration à l’internationalisation et l’accès inégal aux standards qui la conditionnent réellement.

Le problème central est un glissement (fréquent dans les discours institutionnels et les usages locaux) entre l’indexation comme infrastructure et l’indexation comme label. Autrement dit, un dispositif conçu pour organiser l’accès à l’information est progressivement détourné en certificat de qualité. Cette conversion redéfinit les stratégies éditoriales, les pratiques de communication des revues, et, in fine, les comportements de publication des auteurs. Pour analyser ce glissement, cet article articule une approche d’économie politique de l’évaluation à un éclairage décolonial sur la production de la reconnaissance.

Par économie politique de l’évaluation, on entend ici l’analyse des rapports de pouvoir qui structurent la production, la circulation et la reconnaissance des savoirs, en interrogeant les sources de la fixation des standards, du contrôle des instruments, et les modalités de distribution de la valeur académique. Les débats actuels à l’échelle internationale sur la réforme de l’évaluation insistent précisément sur la nécessité de décorréler la valeur de la recherche de proxys de réputation adossés aux contenants plutôt qu’au contenu et à la diversité réelle des contributions. En Afrique, cette dynamique rejoint une contrainte plus ancienne décrite par Paulin Hountondji sous le terme d’« extraversion ». Dès lors, l’affichage de logos et d’index peut être interprété comme une réponse parfois maladroite, parfois opportuniste, à un régime de visibilité mondial inégal, plutôt que comme une simple stratégie de tromperie.

L’article poursuit deux objectifs. Premièrement, il vise à clarifier la notion d’indexation. Deuxièmement, il montre comment la quête de publication dans des revues indexées fonctionne comme un mot d’ordre aliénant, qui révèle les rapports de pouvoir structurant la communication scientifique à l’échelle globale, mais aussi en Afrique francophone subsaharienne.

Qu’est-ce qu’un index scientifique ?

Il est d’abord nécessaire de comprendre ce à quoi renvoie le terme « indexé ». Un index scientifique est en effet bien plus qu’une simple liste de publications. Il s’agit d’un système d’analyse, de répertoriage et de structuration du contenu des articles de recherche au sein d’une base de données organisée (Rostaing, 1996), dont les fondements ont été posés par Garfield (1955). L’indexation permet de classer les productions académiques en s’appuyant sur un travail d’extraction de contenus afin d’en assurer la diffusion et d’en faciliter la recherche. Sa principale fonction est donc de permettre aux chercheurs de retrouver plus efficacement la littérature pertinente dans un champ donné. On peut concevoir l’index scientifique comme une infrastructure d’exploration de la littérature, où chaque article y est localisable par une adresse normalisée (titre, auteurs, affiliation, mots-clés, résumé, DOI, etc.). Les citations constituent quant à elles des liens traçables qui permettent de reconstituer les filiations intellectuelles. Autrement dit, être indexé, c’est être intégré dans une infrastructure qui organise la littérature savante.

Ce qui distingue les index d’autres bases tient donc à leur capacité à produire de la valeur méthodologique. Ils n’enregistrent pas seulement les articles ; ils tracent aussi les relations de citation, à savoir qui cite qui, combien de fois, voire dans quel contexte. Ce réseau de liens rend possible le calcul d’indicateurs bibliométriques, comme le facteur d’impact ou l’indice h, et permet d’évaluer l’influence relative d’une recherche au sein de sa discipline.

À l’opposé, le signalement désigne l’opération la plus élémentaire qui consiste à mentionner l’existence d’une revue dans un catalogue, un répertoire ou une liste, sans en traiter le contenu article par article. Dans la plupart des cas, les répertoires de signalement ne vérifient pas le caractère scientifique des revues, qui côtoient souvent d’autres objets du genre, comme des bulletins, des magazines ou des médias. Des répertoires comme Directory of Open Access scholarly Resources (ROAD), Mir@bel, EZB, Miar ou Ulrichsweb recensent ainsi des milliers de titres en indiquant leurs caractéristiques éditoriales, mais sans produire d’analyse des liens entre les publications. Le signalement constitue en ce sens une forme de visibilité minimale ; la revue existe aux yeux de la communauté, mais son influence demeure encore non mesurée. Enfin, le référencement occupe une position intermédiaire. Une base de référencement, à l’instar du Directory of Open Access Journals (DOAJ) ou du Diamond Discovery Hub (DDH), recense les revues selon des critères de qualité définis par une communauté scientifique, un consortium ou une institution, sans nécessairement opérer un suivi systématique des articles et de leurs citations. Le référencement constitue une forme de validation éditoriale et disciplinaire qui montre que la revue est reconnue comme scientifiquement sérieuse et pertinente.

Aux origines de l’index de citation

Pour comprendre pourquoi les index de citation se sont imposés, il faut remonter à l’après-guerre. Au milieu des années 1950, le scientifique de l’information Eugene Garfield (1925-2017) affronte un problème concret et urgent : l’explosion documentaire et le décloisonnement des disciplines qui rendent de plus en plus difficile le repérage manuel des sources pertinentes. À cette époque, les systèmes d’indexation traditionnels reposaient sur des indexeurs humains qui devaient manuellement assigner des descripteurs et des mots–clés à chaque article. Ce système présentait trois défauts : il accusait souvent un retard de plusieurs mois, voire d’années, sur la littérature publiée ; son coût restait élevé ; et ses résultats dépendaient largement de l’indexeur. Deux indexeurs travaillant sur le même article assignaient rarement les mêmes descripteurs (Garfield, 1984 ; Guédon & Loute, 2017 ; Wouters, 2017).

Garfield conçoit alors une innovation. Plutôt que de laisser des humains décider de ce qui est pertinent, pourquoi ne pas laisser les scientifiques eux-mêmes l’indiquer à travers leurs citations ? Dans cette logique, une citation est bien plus qu’une référence. Elle constitue, dans l’hypothèse de Garfield, un signal que l’auteur juge l’article cité pertinent pour sa propre recherche, hypothèse dont la sociologie des sciences a ultérieurement montré les limites et les usages stratégiques, puisque les citations peuvent être rituelles, obligatoires, stratégiques, négatives ou erronées. En 1955, Garfield publie son manifeste « Citation Indexes for Science: A New Dimension in Documentation through Association of Ideas », où il explique qu’en capturant automatiquement toutes les citations publiées dans les revues, on crée une topologie du savoir qui émerge des pratiques scientifiques elles-mêmes, sans nécessiter de jugement humain a priori. En 1964, l’Institut pour l’information scientifique (ISI) produit le Science citation index (SCI). Pour la première fois, on peut tracer systématiquement le nombre de citations, et évaluer ce qu’on appelle désormais « l’impact » d’une revue. Celui-ci est calculé sur une année (a) en divisant le nombre de citations reçues par les articles publiés dans la revue au cours des deux années précédant l’année (a), par le nombre total d’articles publiés par la revue pendant la même période.

Web of Science et Scopus comme outils de consolidation de la légitimité

Deux acteurs majeurs dominent et légitiment ce système d’évaluation de la pertinence des revues. Web of Science (WoS), géré par Clarivate Analytics (anciennement Thomson Reuters), et Scopus, lancé en 2004 par la société Elsevier, sont les deux géants de l’indexation scientifique internationale. Leur autorité repose sur plusieurs piliers. D’abord, un processus de sélection présenté comme rigoureux, mais dont les effets se révèlent structurellement discriminatoires. Les index n’acceptent pas automatiquement toutes les revues. Garfield a progressivement imposé un principe de sélectivité reposant sur les core journals, c’est-à-dire un corpus restreint de revues jugées particulièrement influentes dans leur domaine selon des critères bibliométriques (Guédon & Loute, 2017).

Clarivate par exemple, se base actuellement sur 28 critères formels — 24 critères de qualité éditoriale et 4 critères d’impact bibliométrique — mais se réserve une clause de décision sur l’inclusion, le maintien comme le retrait des revues. Plusieurs dimensions de l’évaluation demeurent cependant non explicites, à savoir les seuils de citation exigés pour le passage de l’ESCI vers les index principaux ou l’appréciation qualitative de l’alignement entre le périmètre déclaré et le contenu publié par la revue.

Ensuite, s’est opérée dans l’écosystème une reconnaissance institutionnelle globale. Les universités, les organismes de financement de la recherche et les gouvernements ont progressivement adopté les métriques produites par ces bases dans leurs politiques — le facteur d’impact pour WoS et le CiteScore pour Scopus — afin d’évaluer les chercheurs, d’attribuer des financements et de classer les institutions. Cette adoption systématique crée une boucle de légitimité : plus les institutions utilisent ces métriques, plus elles apparaissent objectives et incontournables ; plus elles apparaissent incontournables, plus les institutions les utilisent (Bernard, 2017 ; Gingras, 2018b ; S. Piron, 2008).

Sélectivité géographique et linguistique

À l’origine conçue comme une infrastructure de repérage et de cartographie des connaissances, l’indexation dans des bases sélectives (et les indicateurs qu’elles produisent) est progressivement devenue un instrument d’évaluation des chercheurs et de leurs institutions de tutelle. Dans beaucoup de contextes, l’indexation dans WoS ou Scopus a glissé de la visibilité et de la trouvabilité de la revue vers un proxy de qualité, au point de parfois supplanter l’examen qualitatif. Une transformation induite par cette logique est que la métrication incite à optimiser ce qui est mesurable, plutôt que ce qui compte scientifiquement. Elle renforce les stratégies de publication des auteurs, lesquelles sont dictées par les critères des grandes bases plutôt que par les besoins des communautés de recherche (Gingras, 2018a).

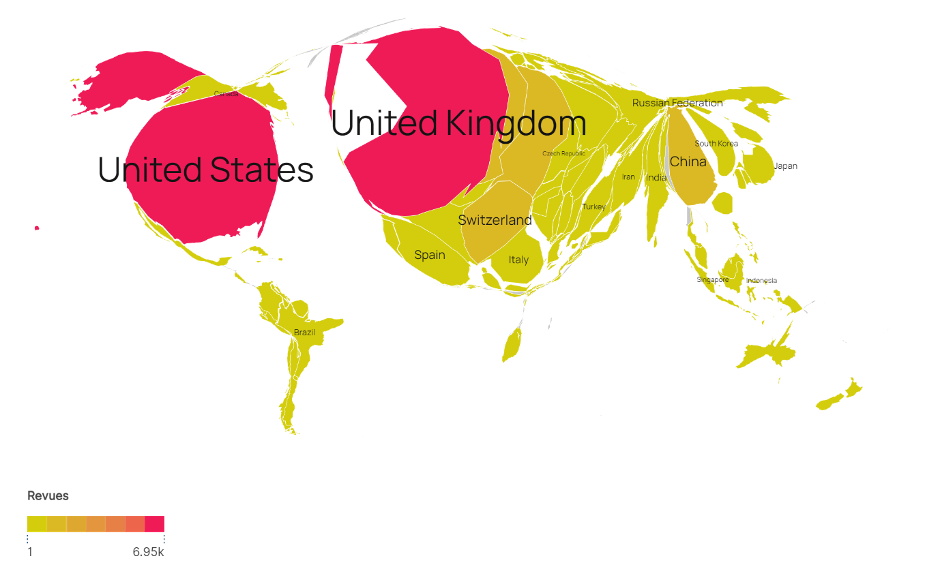

Derrière cette façade de légitimité globale existe un biais structurel bien documenté. Les critiques académiques, en l’occurrence les travaux d’Asubiaro et al. (2024), Gingras et Khelfaoui (2025), Larivière (2019), Maddi et al. (2024), ou encore Mongeon et Paul-Hus (2016) montrent que Web of Science et Scopus n’ont jamais été véritablement globaux. Ils sont, au contraire, profondément sélectifs en faveur de la science anglo-saxonne du Nord global, aux dépens d’autres régions de la périphérie largement invisibilisées. Les revues publiées en Europe sont 30-40 % plus susceptibles d’être indexées dans Web of Science et Scopus, tandis que les revues d’autres régions, notamment l’Afrique subsaharienne, sont 50-60 % moins susceptibles d’être incluses selon Asubiaro et al., (2024).

Les critères d’indexation sont discriminatoires envers les jeunes revues ou celles ancrées dans des communautés scientifiques locales. Pour maintenir l’indexation dans Scopus, une revue doit respecter des critères exigeants sans lesquels un examen du conseil de sélection est déclenché et peut aboutir à la désindexation. Des exigences difficiles à tenir pour les revues jeunes ou centrées sur des sujets que le cœur du système-monde de la recherche (Demeter, 2019) juge peu pertinents, ce qui est le cas de la grande majorité des revues africaines éditées par les chercheurs.

L’étude EIFL (2024) sur les revues africaines en accès libre sans frais fournit un éclairage sur les principaux obstacles rencontrés par ces revues lors des processus d’indexation. Cette documentation permet de comprendre comment elles se retrouvent dans un cercle vicieux. Leur faible visibilité limite leurs citations dans les bases de données internationales, ce qui justifie à son tour leur exclusion continue. Ce mécanisme discriminatoire défavorise les recherches à caractère local, pourtant essentielles pour comprendre et résoudre les problématiques spécifiques aux contextes africains. Les revues sont ainsi piégées dans un paradoxe où leur marginalisation les contraint à une endogamie non choisie, mais qui leur est reprochée, alimentant un cercle vicieux qui perpétue leur invisibilité scientifique. « One can’t get indexed without international authors, but authors are disinclined to publish in a journal that isn’t indexed… it is a chicken and egg kind of thing… you see the loop; nobody can break it », confiait un éditeur nigérian dans l’article de Mills et Branford (2022). Asubiaro et al. (2024) ont montré que les revues publiées en Europe sont de 30 à 40 % plus susceptibles d’être indexées dans Web of Science et Scopus, tandis que celles provenant d’Asie centrale, d’Asie de l’Est, ainsi que d’Afrique subsaharienne sont de 50 à 60 % moins susceptibles d’être incluses.

Carte 1 : Cartogramme des revues indexées dans Scopus (2025)

source : SCImago Journal Rank

Face aux biais de couverture de ces bases de données, plusieurs régions ont développé des dispositifs d’indexation propres afin de rendre visibles des revues de qualité et les productions qui restent marginalisées. En Amérique latine, Latindex (réseau lancé à la fin des années 1990) a précisément pour objectif de recenser et de diffuser l’information sur les revues scientifiques d’Amérique latine, des Caraïbes, d’Espagne et du Portugal, via une approche coopérative et régionale. Dans l’espace arabophone, l’Arabic Citation Index (ARCI) a été lancé en 2020 sur la plateforme Web of Science, avec l’ambition explicite de mieux cartographier la production scientifique en langue arabe et d’améliorer sa découvrabilité et son usage dans l’évaluation de la recherche. Dans la même logique de déploiement d’infrastructures alternatives, on peut aussi citer SciELO/Redalyc en Amérique latine comme des réponses structurelles à une visibilité internationale trop conditionnée par les index dominants.

Des initiatives plus récentes offrent des voies de sortie. OpenAlex, lancée en 2022, fournit un accès démocratisé aux métadonnées bibliométriques, réduisant ainsi le monopole d’Elsevier et de Clarivate (Priem et al., 2022). Cependant, pour que les chercheurs africains reprennent le contrôle de leur propre visibilité informationnelle, il faudrait construire une base de données de citations africaine, avec ses propres critères de sélection et sa propre légitimité institutionnelle. Ce qui est en jeu n’est pas simplement l’indexation, mais la souveraineté intellectuelle et la capacité des communautés africaines. C’est cette logique qu’a défendue Nwagwu (2007, 2008), qui a longtemps plaidé pour un African Citation Index. Il décrit sa proposition comme une infrastructure de citations afrocentrée visant à corriger une invisibilisation persistante. Faute de financement stable et d’adhésion des institutions locales, qui souffrent elles-mêmes de problèmes de financement, le projet a été arrêté. Des récits convergents indiquent également que la recherche de soutiens extérieurs et certaines propositions d’intégration dans des bases commerciales sont entrées en tension avec l’esprit même du projet, rendant sa trajectoire politiquement et stratégiquement difficile (Mills & Asubiaro, 2024).

Aujourd’hui, cette structure persiste. Toutefois, comme l’explique Le Roux (2006), une revue, à ses débuts, fait face à un premier défi majeur : recruter des auteurs de qualité et constituer un lectorat. Passée cette phase de lancement, d’autres enjeux émergent, tout aussi importants pour sa trajectoire de croissance. Ces défis secondaires reposent principalement sur deux piliers : la visibilité de la revue, c’est-à-dire sa reconnaissance au sein de sa discipline et de son contexte géographique, et sa crédibilité auprès de la communauté scientifique. Ce second défi passe souvent par l’indexation ou le référencement de la revue. Dans ce contexte, des éditeurs sont amenés à acquérir des preuves d’indexation, parfois auprès d’acteurs prédateurs, pour répondre aux attentes des auteurs.

Les bases de données : l’angle mort de la prédation scientifique ?

La prédation scientifique a suscité, ces quinze dernières années, une littérature académique foisonnante. Des travaux pionniers de Jeffrey Beall aux études empiriques sur les motivations des auteurs piégés, en passant par les analyses des modèles économiques frauduleux, la communauté scientifique a progressivement cartographié les mécanismes par lesquels certaines revues exploitent la pression à publier (Berger & Cirasella, 2017 ; Boukacem-Zeghmouri et al., 2021 ; Demir, 2018 ; Eriksson & Helgesson, 2018 ; Mills & Inouye, 2021).

Dans le même registre, une partie de la littérature s’est penchée sur les métriques trompeuses (misleading metrics). Elles désignent l’usage stratégique d’indicateurs bibliométriques trompeurs pour donner une apparence de qualité. Les travaux décrivent un écosystème de sociétés spécialisées dans la production de faux facteurs d’impact et d’appellations qui imitent les métriques reconnues par la communauté scientifique, à l’instar du facteur d’impact, du CiteScore ou du SJR, pour exploiter la pression à publier et les évaluations basées sur des indicateurs. Dans la pratique, les acteurs promeuvent des indices alternatifs, comme l’Index Copernicus, le Global Impact Factor ou d’autres métriques obsolètes ou inexistantes (Universal Impact Factor, Arab Impact Factor, Advanced Science Index, etc.). Plus de 50 fausses métriques ont été inventoriées à ce jour (Dadkhah et al., 2022 ; Koçak, 2023).

La croissance des revues prédatrices a considérablement amplifié le phénomène. Aujourd’hui, c’est un sous-écosystème qui génère une économie grise où des éditeurs facturent des frais de publication en échange d’une visibilité fictive et d’une rapidité de traitement scientifiquement intenable. La littérature relie ces métriques trompeuses à d’autres fraudes éditoriales, comme les revues détournées (hijacked journals) oule phishing éditorial, où la crédibilité se construit par imitation (Dadkhah et al., 2016). Face à ce défi, la communauté académique s’appuie sur des outils comme Beall’s List (désormais rétractée, mais actualisée par des collectifs anonymes), PubPeer, DOAJ, ainsi que des protocoles de vérification comme Compass to Publish ou encore « Think. Check. Submit. ».

L’écosystème prédateur : une infrastructure de légitimation

Pour comprendre la place qu’occupent les index prédateurs dans l’écosystème de la communication scientifique, il faut d’abord partir du constat selon lequel la prédation ne fonctionne pas comme un phénomène isolé, mais comme un système. Ce système repose sur une chaîne de légitimation où chaque élément renforce les autres. Une revue prédatrice peut certes publier n’importe quel article moyennant paiement, mais son efficacité dépend de sa capacité à simuler les attributs d’une revue légitime : un comité éditorial (souvent fictif), un processus d’évaluation (souvent inexistant ou inefficace) et, surtout, une pseudo-indexation dans des bases de données qui lui confèrent une apparence de reconnaissance institutionnelle (Azilan, 2025). C’est là qu’entrent en jeu les index prédateurs. Ils offrent aux revues frauduleuses un vernis de crédibilité. En affichant des indexations, ces revues passent du statut de prédateur évident à celui d’acteur apparemment légitime. Pour un chercheur peu familier des standards internationaux, ce simulacre peut suffire à dissiper les doutes.

Les effets sont au moins de deux ordres. D’abord, les index prédateurs brouillent les repères. Dans un environnement où la légitimité scientifique repose encore largement sur des indicateurs quantifiables, la multiplication de fausses métriques crée une confusion généralisée. Ensuite, un marché se forme, où la rapidité et le coût tendent à supplanter la qualité comme critères de décision. Lorsqu’un éditeur découvre qu’une indexation instantanée s’achète pour quelques dizaines de dollars, ou qu’il est possible d’afficher un facteur d’impact sans satisfaire aux exigences éditoriales et techniques réelles, la tentation d’emprunter la voie frauduleuse peut être forte. La prédation ne se contente donc pas d’exploiter les failles du système académique : elle les creuse, les institutionnalise et les transforme en normes de fait. Cependant, il convient de noter que les index prédateurs ne ciblent pas uniquement les revues et éditeurs intrinsèquement prédateurs. En quête de légitimité à tout prix, nombre de revues pourtant bien intentionnées peuvent être touchées par des index prédateurs.

Portrait d’un acteur ambigu : Index Copernicus

Index Copernicus illustre une zone grise où un dispositif de visibilité et de notation paramétrique peut être mobilisé comme substitut d’évaluation scientifique, avec des effets délétères sur les revues des Suds. Le problème central n’est pas l’existence d’un indicateur alternatif en soi, mais la manière dont il est socialement réinterprété comme un label de qualité, puis incorporé dans des économies locales de reconnaissance.

Au cœur de l’offre d’Index Copernicus figure l’Index Copernicus Value (ICV), présenté comme un résultat d’évaluation fondé sur 41 critères regroupés en deux composantes : « quality of the journal » et « journal’s impact ». Dans sa présentation officielle, la composante quality de l’ICV s’articule autour de critères comme les « standards, stability, digitalization and internationalization », de quoi ancrer l’outil dans une logique de conformité fonctionnelle. Index Copernicus précise que l’ICV repose sur des données paramétriques déclarées par les éditeurs via des questionnaires, et non sur un calcul de citations.

Évaluer la stabilité ou la structuration éditoriale d’une revue peut aider les revues en quête de maturité. Le glissement problématique intervient quand cette paramétrisation est présentée, ou simplement perçue, comme une mesure de qualité scientifique, c’est-à-dire comme une garantie de rigueur méthodologique, de robustesse du processus d’évaluation par les pairs, voire d’intégrité éditoriale. Cette confusion est d’autant plus risquée qu’elle rend commensurables des revues hétérogènes sur la base de critères dont la fonction première est organisationnelle, et non épistémique (Watson & Zhang, 2025).

Index Copernicus figure d’ailleurs explicitement parmi les index trompeurs recensés sur des sites de revues prédatrices (Mondal & Mondal, 2019). Pour les revues du Sud, l’effet est particulièrement nocif. La quête de reconnaissance internationale bute déjà sur des asymétries de ressources, et la tentation est forte de convertir cette rareté en stratégie d’affichage. Dans un tel contexte, une métrique paramétrique facilement mobilisable peut alors orienter les investissements vers l’apparat au détriment de chantiers plus fondamentaux, mais également plus gourmands en ressources, tels que la qualité de l’évaluation par les pairs, la production de métadonnées riches, les politiques éthiques, d’archivage, etc. Cette dynamique alimente une économie de l’apparence qui fragilise les revues sérieuses, mais peu outillées et offre un abri symbolique aux acteurs opportunistes. Concrètement, cela peut enfermer des revues en consolidation dans une dépendance à des labels périphériques qui n’améliorent ni leur intégration dans les circuits de lecture, ni leur crédibilité auprès d’instances exigeantes. Le résultat est une double peine, dans le sens où ces revues dépensent énergie et ressources pour des signes de reconnaissance contestés, pendant que la méfiance associée aux métriques trompeuses rejaillit sur le paysage éditorial africain.

Le Cames, catalyseur involontaire ?

Officiellement, la réforme du dispositif d’évaluation du Conseil africain et malgache pour l’enseignement supérieur (Cames) pour la période 2024–2028 s’inscrit dans l’objectif de garantir la qualité des recherches grâce à une « évaluation objective par les pairs », adossée à un « référentiel validé aux normes internationales » (p. 6). Le guide d’évaluation stipule que l’indexation permet de s’assurer que la revue respecte des standards élevés, parmi lesquels l’existence et la constitution d’un comité de lecture, l’évaluation par les pairs, la rigueur de la bibliographie, la régularité dans les parutions, la citation des articles, le facteur d’impact et la visibilité globale de la revue (p. 55). La note précise que les bases d’indexation fournissent des résumés et des indicateurs bibliométriques qui permettent d’avoir une « appréciation qualitative des revues », des textes publiés, ainsi que des auteurs et chercheurs.

Cette réforme est donc un geste politique d’alignement sur les normes internationales de la science, une adhésion aux standards académiques dominants pour renforcer la légitimité mondiale de l’institution. Elle peut tout aussi bien être analysée comme un cas d’isomorphisme institutionnel, au sens où le Cames reproduit des modèles d’évaluation en vigueur au centre du système-monde de la recherche, sans en avoir nécessairement éprouvé la pertinence épistémique pour le contexte local. Enfin, on peut aussi y lire une décision technocratique, portée par des experts internes convaincus de la supériorité des indicateurs bibliométriques comme outils de mesure de la qualité scientifique, indépendamment de tout calcul politique.

Quoi qu’il en soit, en érigeant l’indexation dans les bases de données payantes — auxquelles les chercheurs africains n’ont souvent pas accès — en critère prioritaire, l’institution endosse explicitement une stratégie de montée en généralité vers le global. La décision est pensée comme une rationalisation de l’excellence et de la visibilité internationale ; elle peut également être vue comme un moyen d’éviter que les revues ne s’orientent vers les index douteux. Toutefois, elle doit être interrogée comme une opération de traduction d’objectifs académiques en dispositifs marchands. Ce déplacement redéfinit ce qui compte comme science valable pour la communauté concernée, en l’occurrence l’Afrique subsaharienne francophone.

Le paradoxe est d’autant plus frappant que, dans plusieurs espaces centraux du système scientifique mondial, les institutions commencent précisément à déconstruire les dépendances aux industries de l’indexation qui se sont forgées depuis les années 1960. On observe, à des degrés divers, une prise de distance vis-à-vis des métriques propriétaires et des classements au profit d’initiatives de réforme plus qualitatives de l’évaluation de la recherche (Dora, Leiden Manifesto, CoARA). Cet investissement privilégie désormais les infrastructures ouvertes (données bibliographiques et citations ouvertes, entrepôts, logiciels communautaires, etc.). En France, le CNRS, par exemple, a fortement structuré sa politique de science ouverte autour d’outils qui visent à réduire l’hégémonie des bases commerciales dans l’observation et la description de l’activité scientifique, à réinscrire une partie des fonctions de l’évaluation dans des communs informationnels et à rompre avec une évaluation trop quantitative de la recherche. L’annonce motivée par ces raisons, à la fin de l’année 2025, du désabonnement au WoS de cette institution de recherche, une des plus grandes au monde, est un évènement particulièrement marquant de cette démarche.

Dans ce contexte, la trajectoire du Cames peut être lue comme un rattrapage par les instruments traditionnel de la communication savante, au moment même où ces instruments sont remis en question là où ils ont été élaborés. La question n’est donc pas seulement de savoir comment rendre la recherche africaine visible. Elle se pose davantage en termes en termes de grammaires de valeur de la visibilité, en en interrogeant les bénéficiaires et les conséquences sur les priorités et les orientations de la recherche. En faisant de WoS/Scopus des passages obligés pour les chercheurs, le Cames réactive une économie politique de la visibilité fondée sur la rareté, la concurrence et la rente, plutôt que sur la circulation et la mutualisation propres à une logique de communs, à laquelle l’écosystème de la production des savoirs en Afrique est souvent plus proche.

Ce choix produit mécaniquement un effet de seuil selon lequel la survie et l’intérêt des revues locales dépendent de leur capacité à entrer dans le club fermé de WoS/Scopus. La conséquence la plus préoccupante n’est pas uniquement l’exclusion, mais la vulnérabilisation de tout un écosystème déjà déséquilibré. Quand la reconnaissance institutionnelle est convertie en accès à une base sélective, se met en place une économie de l’intermédiation dans laquelle s’activent consultants, courtiers de réputation, promesses d’indexation, optimisation opportuniste et inflation d’insignes de légitimité. Ainsi, le badge collecting observé chez les revues locales est l’expression d’une contrainte à la production de signes de conformité dans un environnement où celle-ci conditionne cette survie. Mais cette prolifération sème la confusion entre enregistrement, référencement et certification, puis crée un marché de l’apparence fertile à l’éclosion de la prédation.

C’est là que la problématisation décoloniale devient décisive. La réforme peut se lire comme une forme de gouvernement par l’extraversion dans laquelle pour exister, il faut être validé ailleurs, par des dispositifs dont les critères et les économies ont été façonnés hors du continent. La notion d’« extraversion » chez Hountondji (1990, 1995), c’est-à-dire une orientation externe de la production de savoirs vers les attentes, les grilles de lecture et les besoins (théoriques et pratiques) des centres dominants, au détriment de la constitution de débats horizontaux et d’agendas endogènes, permet d’éclairer la tension. La recherche se trouve sommée de parler la langue des arènes dominantes, de choisir des objets et des sujets exportables, et d’adopter les formats valorisés par les circuits globaux, au risque de traiter la pertinence locale comme une spécialisation périphérique, moins comptable, donc moins rentable symboliquement. Cette extraversion est avant tout épistémique, en plus d’être éditoriale et linguistique. Les Epistemologies of the South (Santos, 2015) offrent ici un cadre pour penser la violence symbolique des hiérarchies de connaissance, ce que Santos nomme l’injustice cognitive et, à terme, l’épistémicide que subit tout savoir non aligné sur les standards dominants (Nkoudou, 2016 ; Piron, 2018). Du côté des sciences sociales, la proposition de Bhambra (2014) autour des « connected sociologies » invite à reconstituer les savoirs et leurs canons en replaçant au centre l’histoire coloniale-globale qui a constitué les disciplines et leurs normes, au lieu de traiter l’eurocentrisme comme un biais périphérique.

Le Cames se situe ainsi à un carrefour ambigu vis-à-vis des luttes décoloniales. D’un côté, l’argument de la visibilité internationale peut apparaître comme un refus de l’assignation à la marginalité des revues locales. De l’autre, la modalité choisie tend à reconduire les mêmes mécanismes que les critiques décoloniales identifient comme producteurs d’inégalités épistémiques. La tension vécue par les chercheurs est qu’ils doivent à la fois répondre à des problématiques locales et se rendre lisibles dans des espaces où la reconnaissance passe par des conventions externalisées. Cette double contrainte risque d’installer une dépendance durable aux infrastructures académiques du Nord qui répondent parfois à des logiques commerciales. Plus que jamais, les Communs offrent une autre orientation possible pour l’économie politique de la communication scientifique. La principale question n’est donc pas de savoir si le Cames fait bien de viser l’international, mais comment il choisit de l’atteindre : par la consolidation de standards propriétaires ou par une stratégie de visibilité fondée sur des communs, des bases de données ouvertes et une pluralisation des critères de qualité adaptés aux écologies de revues africaines ? En l’état, l’alignement sur WoS/Scopus agit comme un catalyseur involontaire qui offre aux acteurs commerciaux un marché qui leur a souvent résisté. Cela renforce donc leur pouvoir et les hiérarchies Nord-Sud qui caractérisent déjà le système-monde de la recherche, et ouvre un espace de prédation où la simulation de légitimité risque de devenir une réponse rationnelle à l’injonction d’être visible, y compris lorsque cette visibilité ne sert ni les communautés scientifiques locales, ni globales, encore moins les projets de décolonisation des savoirs.

Conclusion

La distinction entre indexation, référencement et signalement — où l’indexation désigne l’intégration d’une revue dans une base de données avec extraction et traitement automatisés des métadonnées, le référencement renvoie à une simple mention ou inscription dans un répertoire sans traitement systématique, et le signalement correspond à une visibilité minimale, ponctuelle et non normalisée —, proposée ici comme outillage conceptuel, n’est pas qu’une clarification terminologique. Elle révèle que cette confusion est le produit de conditions structurelles inégales dans lesquelles s’inscrivent les revues africaines. Cette clarification permet de comprendre comment un instrument d’accès à la littérature est converti en proxy de légitimation, puis incorporé dans des régimes locaux de reconnaissance, au point de reconfigurer les pratiques éditoriales et les comportements de publication des chercheurs. L’analyse a surtout mis en évidence que lorsque la reconnaissance institutionnelle repose sur des instruments, l’angoisse d’invisibilité et la rareté d’accès ouvrent un espace à l’intermédiation et à l’économie de l’apparence qui favorisent les pratiques illégitimes. Dans ce cadre, les index trompeurs participent à la normalisation d’une légitimité à moindre coût, fondée sur des instruments. Enfin, replacer ces dynamiques dans une lecture décoloniale conduit à repenser l’enjeu. Il ne s’agit pas seulement de rendre visible la science africaine, mais de choisir les mécanismes de visibilité qui la gouvernent. Le texte suggère ainsi une voie de sortie cohérente avec les principes de réforme de l’évaluation promus notamment par la Déclaration de San Francisco (Dora, 2012) et la Coalition for Advancing Research Assessment (CoARA, 2022), qui visent précisément à désolidariser l’évaluation des seuls labels de revue au profit d’une appréciation plus directe des contributions scientifiques. Ainsi, la visibilité ne doit plus être le produit d’une conformité à des standards externes, mais le résultat d’une gouvernance scientifique maîtrisée.